머신 러닝 마스터를 위한 7가지 GitHub 프로젝트

머신러닝 운영(MLOps)은 때로는 압도적으로 느껴질 수 있는 넓은 분야입니다. 그러나 AI 모델을 실제 환경에 배포해야 하는 필요성이 있기 때문에, 이 분야는 포스트-AI 시대에도 번창할 가능성이 높습니다.

여러분의 학습 여정을 돕기 위해, 초급부터 전문가 수준까지 7개의 GitHub 프로젝트를 정리했습니다. 이 프로젝트들은 배포, 자동화, 오케스트레이션 등 필수적인 MLOps 개념을 다룹니다.

초급 레벨 프로젝트

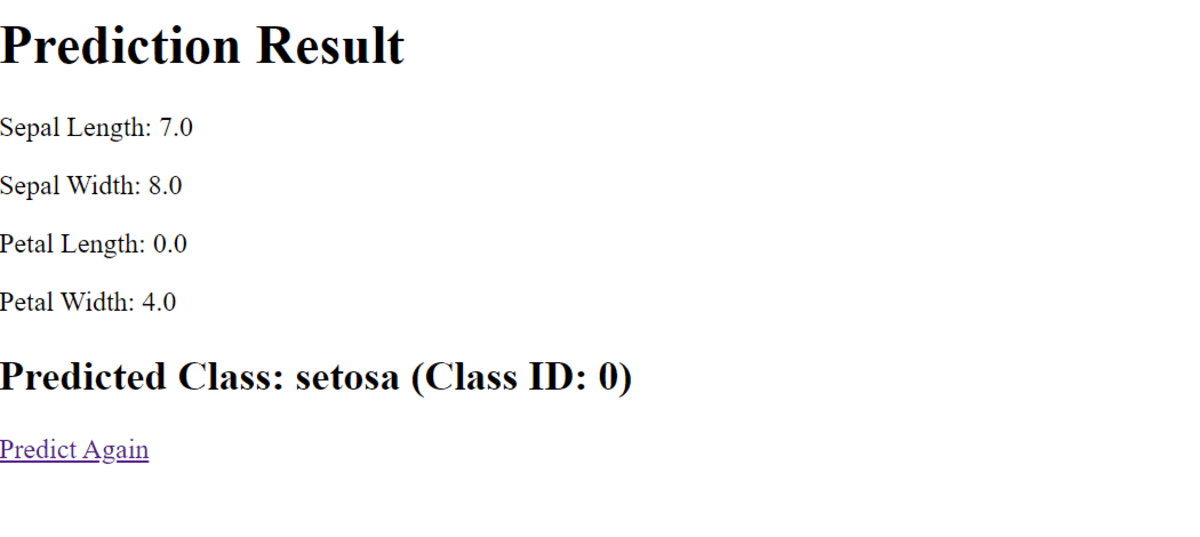

1. FastAPI-for-ML

핵심 기술: FastAPI, 모델 추론, API 개발

이 프로젝트는 API를 통해 머신러닝 모델을 제공하는 방법을 배우고 싶은 초보자에게 완벽합니다. 모델 추론을 위한 간단한 FastAPI 애플리케이션을 구축하는 과정을 안내합니다. 이 프로젝트를 마치면 ML 모델을 REST API로 제공하는 방법을 이해하게 될 것이며, 이는 실제 애플리케이션에 ML 솔루션을 배포하기 위한 기본적인 기술입니다.

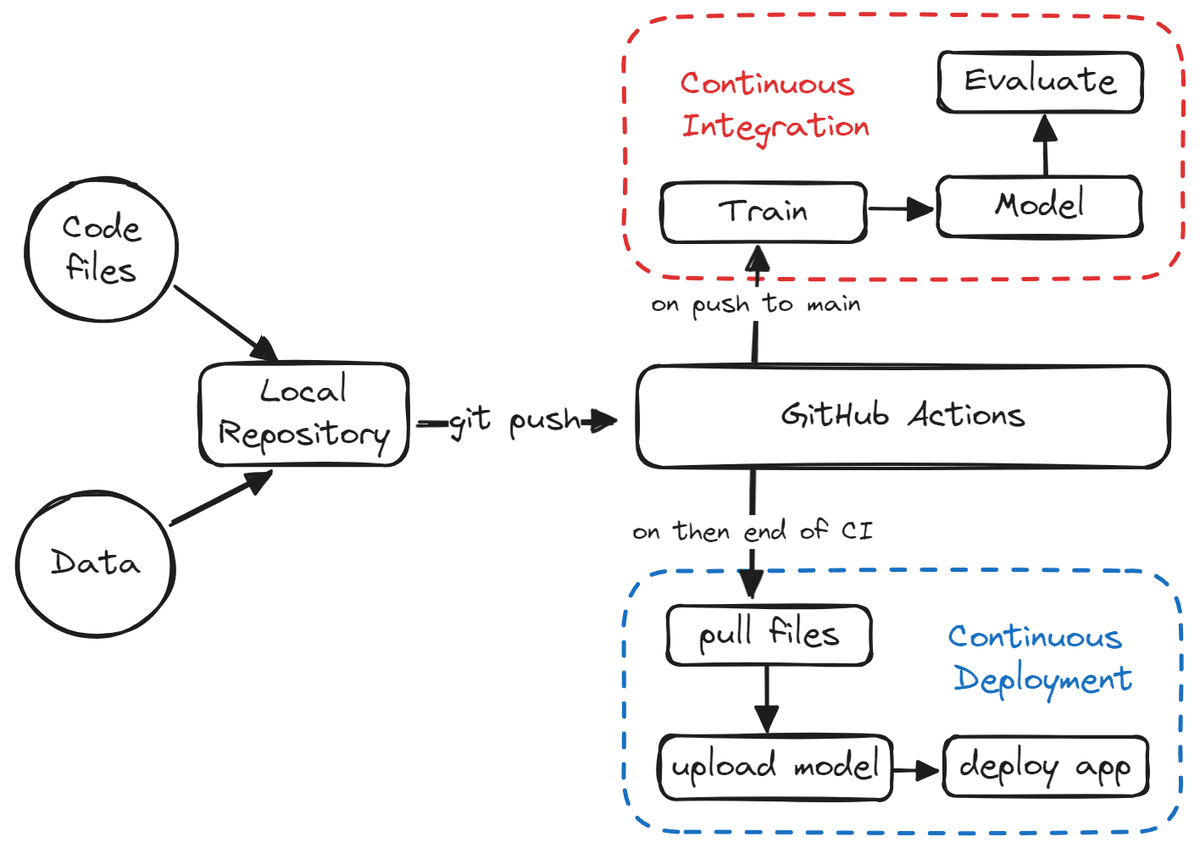

2. CICD-for-Machine-Learning

핵심 기술: CI/CD, GitHub Actions, 모델 학습 및 배포

이 초보자 친화적인 프로젝트는 머신러닝을 위한 지속적 통합/지속적 배포(CI/CD)를 소개합니다. GitHub Actions를 사용하여 ML 모델의 학습, 평가, 버전 관리 및 배포를 자동화하는 방법을 배우게 됩니다. 자동화가 ML 워크플로우를 간소화하고 수동 오류를 줄이는 방법을 이해하는 좋은 방법입니다.

중급 레벨 프로젝트

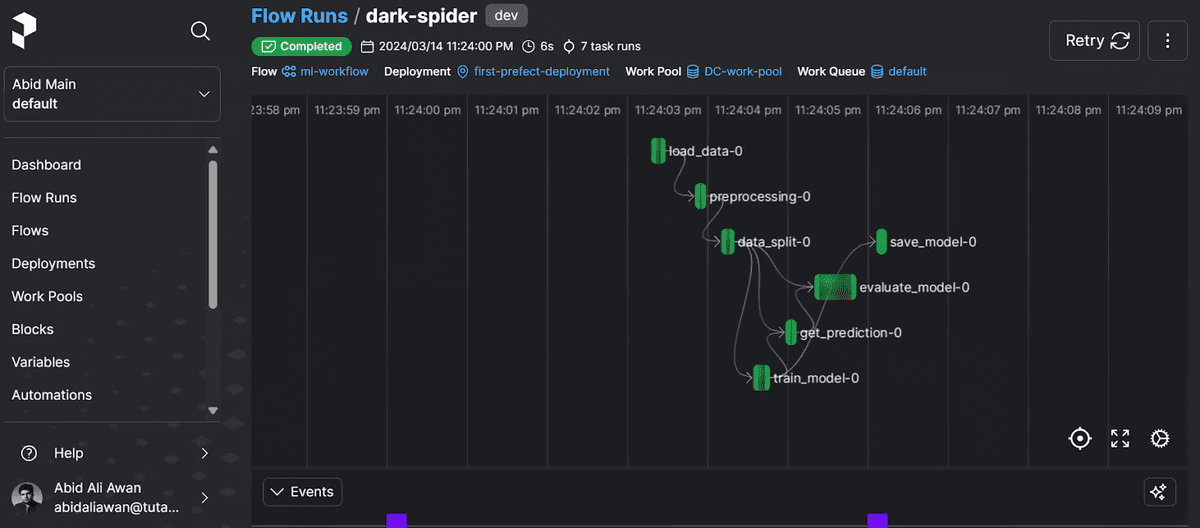

3. ML-Workflow-Orchestration-With-Prefect

핵심 기술: ML 파이프라인, 워크플로우 오케스트레이션, 알림

이 프로젝트는 Prefect라는 강력한 도구를 사용한 워크플로우 오케스트레이션을 소개합니다. 데이터 수집, 모델 학습, 저장과 같은 작업을 간소화하는 방법을 배우고, 파이프라인 진행 상황을 모니터링하기 위한 Discord 알림을 통합하는 방법도 알게 됩니다. 복잡한 ML 워크플로우를 효율적으로 관리하고자 하는 사람들에게 탁월한 프로젝트입니다.

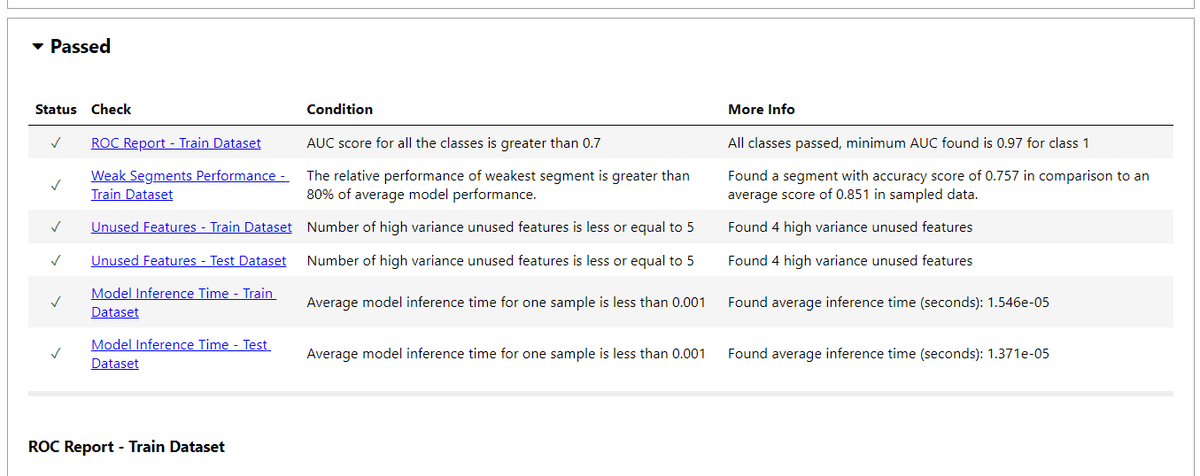

4. Automating-Machine-Learning-Testing

핵심 기술: GitHub Actions, DeepChecks, 모델 테스팅

테스팅은 머신러닝에서 중요하지만 종종 간과되는 측면입니다. 이 프로젝트는 GitHub Actions와 DeepChecks를 사용하여 ML 테스팅을 자동화하는 방법을 가르칩니다. 데이터 무결성과 모델 드리프트와 같은 문제를 테스트하여 모델이 시간이 지남에 따라 신뢰성을 유지하도록 하는 방법을 배우게 됩니다. 이 프로젝트는 ML 워크플로우에 강력한 테스팅 관행을 도입하고자 하는 중급 학습자에게 이상적입니다.

고급 레벨 프로젝트

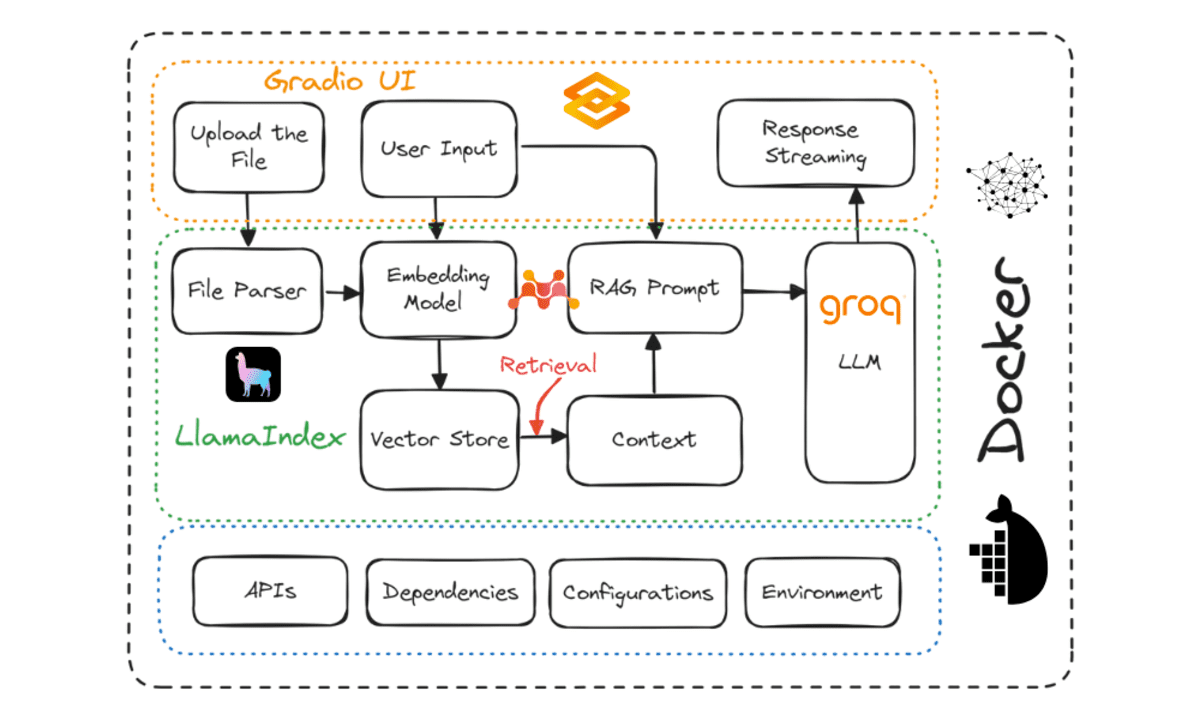

5. Deploying-LLM-Applications-with-Docker

핵심 기술: Docker, Hugging Face, LLM, LlamaIndex, Gradio

이 프로젝트는 Docker를 사용하여 Hugging Face 클라우드에 대규모 언어 모델(LLM)로 구동되는 문서 Q&A 애플리케이션을 배포하는 데 중점을 둡니다. 컨테이너화 및 확장 가능한 ML 애플리케이션 배포에 대해 배우는 좋은 방법입니다. 고급 학습자는 LLM을 위한 최신 배포 방식을 실습할 수 있습니다.

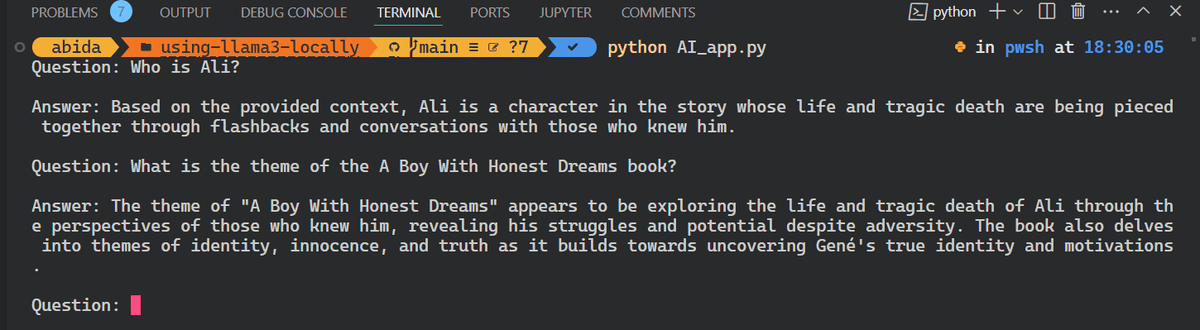

6. using-llama3-locally

핵심 기술: Ollama, LangChain, Chroma, LLMs

이 프로젝트는 로컬에서 Llama 3를 실험하고 싶은 사람들을 위한 것입니다. Ollama-Python, LangChain, Chroma와 같은 도구를 사용하여 모델을 실행하고 상호작용을 위한 사용자 인터페이스를 구축합니다. LLM 파이프라인의 내부 구조를 깊이 파고들고 최첨단 모델을 로컬에서 작업하는 방법을 이해할 수 있는 좋은 기회입니다.

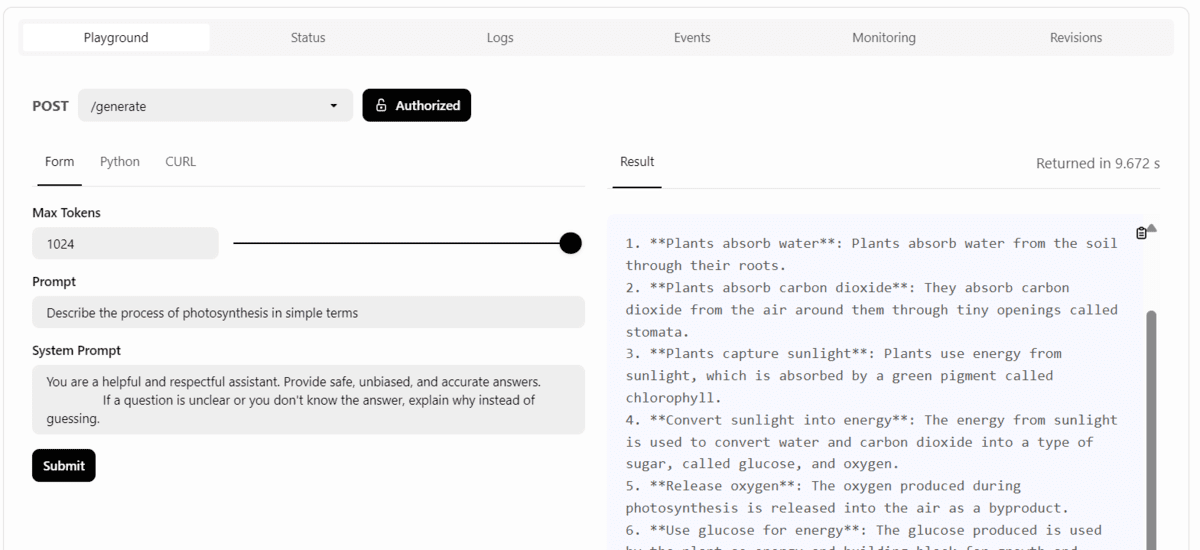

7. Deploying-Llama-3.3-70B

핵심 기술: vLLM, AWQ 양자화, BentoCloud, BentoML

이것은 목록에서 가장 고급 프로젝트입니다. vLLM과 AWQ 양자화를 사용하여 최적화된 성능으로 Llama 3.3 70B를 배포하는 방법을 가르칩니다. 또한 BentoCloud에 모델을 배포하여 프로덕션 환경에서 대규모 모델 배포 경험을 얻을 수 있습니다. 이 프로젝트는 LLM 배포의 경계를 넓히고자 하는 전문가에게 이상적입니다.

마치며

이 프로젝트들은 모델 서빙, 테스팅, 자동화, 배포에 관한 새로운 것을 가르치도록 설계되었습니다. 초급 프로젝트는 API 엔드포인트 생성 및 CI/CD 설정에 중점을 둡니다. 중급 프로젝트는 머신러닝 워크플로우를 설정하고 전체 머신러닝 라이프사이클을 자동화하는 쉬운 방법을 소개합니다. 고급 프로젝트는 대규모 언어 모델 처리, LLM 애플리케이션 구축, Docker를 사용한 배포, 클라우드에서 700억 파라미터 서빙에 관한 것입니다.